Estamos perdiendo el volante

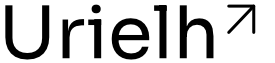

La Trampa del Hámster: Por Qué la IA Está Agotando al Talento Que Prometía Liberar

Cuando adoptamos la inteligencia artificial sin rediseñar el trabajo, no aceleramos el futuro. Fabricamos una versión más eficiente del agotamiento.

01 – Cuatro de la mañana en el Valle del Silicio

Garry Tan, el hombre que dirige Y Combinator —la incubadora que parió a Airbnb, Stripe y Dropbox—, confesó algo frente a una audiencia en SXSW 2026 que no estaba en el guion de ningún keynote optimista sobre la IA. Dijo que dormía cuatro horas por noche. No porque sus agentes de IA fallaran, sino porque funcionaban demasiado bien. “Tengo ciberpsicosis”, admitió, medio en broma, medio en diagnóstico. “Y creo que un tercio de los CEOs que conozco también la tienen.” Describió la sensación de trabajar con sus agentes nocturnos como algo que antes requería modafinil —la droga que el mundo startup usa para eliminar el sueño como si fuera una debilidad— pero que ahora ocurre de forma natural: la excitación de ver construirse, en tiempo real, lo que antes tomaba diez personas, dos años y diez millones de dólares.

Esa imagen —un CEO brillante, sonriente, privado de sueño, hipnotizado por sus propias herramientas a las cuatro de la mañana— no es la postal del triunfo tecnológico. Es el síntoma más honesto de una crisis que la industria prefiere no nombrar.

· · ·

02 – La Promesa Rota

Había un trato implícito en cada presentación corporativa sobre IA desde 2022: la tecnología absorbería lo repetitivo para que los humanos pudieran dedicarse a lo estratégico. Automatizar lo tedioso, liberar el juicio. Esa era la promesa. El intercambio era sencillo: tú cedes las tareas mecánicas; la máquina te devuelve tiempo y profundidad cognitiva.

Lo que ocurrió fue otra cosa.

El Upwork Research Institute encuestó en 2024 a 2.500 trabajadores —ejecutivos, empleados de tiempo completo y freelancers— en cuatro países, y encontró que el 77% de quienes usan IA reporta que esas herramientas han aumentado su carga de trabajo. No la redujeron. No la redistribuyeron hacia tareas de mayor valor. La inflaron. El tiempo antes ocupado por tareas repetitivas ahora se llena de supervisar los contenidos que genera la IA, aprender interfaces que cambian cada mes y cumplir con una demanda de producción que creció precisamente porque el jefe vio la misma presentación optimista sobre eficiencia. El 71% de esos empleados reporta burnout. Uno de cada tres dice que probablemente renuncie en los próximos seis meses.

A este fenómeno lo llamaremos el Efecto Hámster: más velocidad, misma rueda, ningún destino nuevo.

· · ·

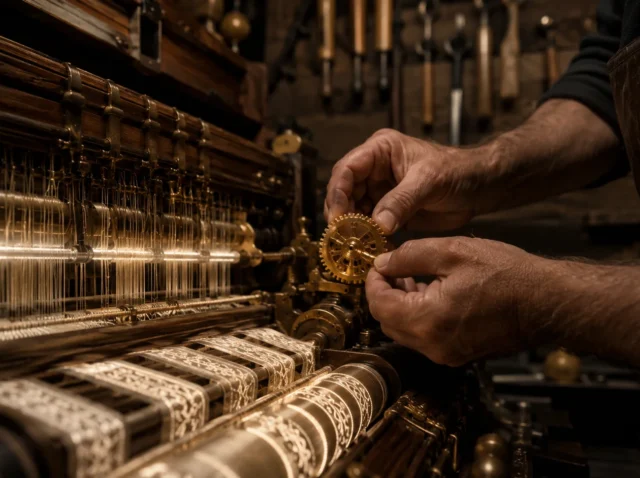

03 – La Frontera Quebrada

Hay un estudio que debería colgar enmarcado en la sala de juntas de cualquier empresa que esté “implementando IA”. En 2023, un equipo de investigadores de Harvard Business School, Wharton, MIT Sloan y Warwick University se alió con Boston Consulting Group para hacer algo que rara vez ocurre en el mundo corporativo: un experimento controlado con 758 consultores reales, tareas reales, y medición ciega de resultados.

Lo que descubrieron tiene la elegante brutalidad de los hechos que nadie quiere escuchar.

Cuando los consultores usaban GPT-4 para tareas dentro de las capacidades actuales del modelo —creatividad, ideación, síntesis de contenidos—, el 90% mejoraba su desempeño. Completaban 12% más tareas, 25% más rápido, con calidad significativamente superior. Los peores ejecutores del grupo eran los que más ganaban: un 43% de mejora para quienes partían desde el piso. La IA actuaba como ecualizador. Maravilloso.

Pero los investigadores diseñaron deliberadamente un segundo tipo de tarea: un problema de negocio complejo, con datos cuantitativos y cualitativos entrelazados, sin una respuesta que el modelo pudiera extraer de su entrenamiento. Una tarea fuera de la frontera. Y allí ocurrió lo contrario: quienes usaron IA fueron un 19 puntos porcentuales menos probables de llegar a la solución correcta que quienes trabajaron solos. La herramienta no solo no ayudó. Degradó activamente el pensamiento. El profesional dejó de razonar y aceptó la respuesta fluida, bien redactada, plausible y equivocada que el modelo le entregó con toda la confianza del mundo.

Dell’Acqua, el autor principal del estudio, lo llamó la frontera tecnológica irregular: la IA no tiene capacidades uniformes. Algunas tareas caen dentro, otras caen fuera, y la frontera es invisible. Lo más peligroso no es que la herramienta falle. Es que falla con apariencia de competencia.

· · ·

04 – El Dinero Sin Destino

Y aun así, el dinero sigue fluyendo.

EY encuestó en 2025 a 15.000 empleados y 1.500 empleadores en 29 países para su estudio Work Reimagined. El hallazgo central: el 88% de los empleados ya usa IA en el trabajo. Pero solo el 28% de las organizaciones ha logrado posicionar ese uso para generar impacto real de negocio. El resto opera en una especie de teatro de la adopción: compran licencias, lanzan pilotos, mandan a sus equipos a talleres de prompting, y esperan que la eficiencia emerja sola, como si la tecnología fuera un hongo que crece con la humedad del presupuesto.

El MIT lo confirmó desde otro ángulo. Su iniciativa NANDA, tras analizar 150 entrevistas con directivos, 350 encuestas a empleados y 300 despliegues públicos de IA, encontró que el 95% de los pilotos empresariales de IA generativa no entregan retorno financiero medible. No es el modelo el que falla. Es la integración: herramientas genéricas injertadas en flujos de trabajo que no fueron rediseñados, sobre culturas organizacionales que no fueron preparadas, con métricas de éxito que siguen siendo las mismas del mundo pre-IA.

Las empresas están comprando el velocímetro sin cambiar el motor.

Y mientras el ROI se estanca, el capital humano —que es, en última instancia, el único activo que puede pensar, adaptarse y generar valor inesperado— se consume en una espiral de upskilling forzado, vigilancia constante de outputs generados por máquinas, y la presión sorda de una obsolescencia que se siente más cercana cada trimestre.

· · ·

05 – El Tecnoestrés Tiene Cuarenta Años

No deberíamos estar sorprendidos. En 1984 —el mismo año en que Orwell imaginó una distopía de vigilancia total— el psicólogo Craig Brod publicó Technostress: The Human Cost of the Computer Revolution. Brod describió algo que entonces parecía específico de los operadores de computadoras mainframe: la incapacidad de adaptarse de forma saludable a las tecnologías emergentes, con consecuencias que iban desde la ansiedad crónica hasta la despersonalización laboral.

Cuarenta años después, ese concepto no envejeció. Mutó.

El tecnoestrés de 2026 no es el de alguien que no sabe usar la herramienta. Es el de alguien que la usa perfectamente bien, que produce más que nunca, y que sin embargo siente que su juicio se vuelve prescindible, que su intuición profesional —construida en años de práctica— vale menos que un prompt bien escrito. Aparece como lo que algunos llaman el Síndrome del Impostor Tecnológico: la sensación de que la máquina hace lo que tú hacías, solo que más rápido y sin quejarse.

Esta crisis no tiene nombre en los cuadros de mando. No aparece en las métricas de adopción de IA que el equipo directivo presenta con orgullo en el board. Pero se filtra en los índices de rotación, en el ausentismo que nadie conecta con la fatiga cognitiva, en la calidad de las decisiones que se degrada silenciosamente cuando el profesional ha delegado tanto razonamiento que ya no sabe dónde termina su criterio y dónde empieza la inercia del modelo.

· · ·

06 – Lo Que No Está en el Manual de Adopción

Hay una pregunta que las organizaciones evitan hacerse porque su respuesta exige desacelerar: ¿estamos implementando IA para liberar la capacidad humana, o para extraerla hasta el último bit antes de que el talento colapse?

La diferencia no es filosófica. Es operativa. Y es medible.

Las organizaciones que sí están generando valor real con IA —ese 28% que EY identifica como el grupo de vanguardia— no se diferencian por tener acceso a mejores modelos. Todos tienen acceso a los mismos modelos. Se diferencian por haber rediseñado el trabajo antes de insertar la tecnología: definieron qué tareas caen dentro de la frontera del modelo y cuáles requieren juicio humano irreemplazable, construyeron métricas que miden valor estratégico y no solo volumen de output, y —esto es lo más incómodo de admitir— invirtieron más en cultura y resiliencia que en licencias de software.

El fracaso del 72% restante no es técnico. Es de concepción. Alguien confundió adopción con transformación. Confundió velocidad con dirección. Confundió producir más con crear mejor.

La IA es un amplificador. Si amplifica caos, produce caos más rápido. Si amplifica talento saludable con criterio claro, produce algo que ningún modelo puede generar solo: ventaja competitiva sostenible.

· · ·

07 – La Última Pregunta

Garry Tan se despertó a las ocho de la mañana después de dormir cuatro horas porque quería ver qué habían hecho sus agentes mientras dormía. Hay algo genuinamente asombroso en eso. También hay algo que reconocemos, en algún rincón poco iluminado de nuestra experiencia laboral, como una trampa con forma de entusiasmo.

La pregunta que cada organización debería hacerse no es cuántos nodos de IA tiene activos. Es cuántos de sus profesionales llegan el lunes con el tipo de energía que construye algo que importa, en lugar del tipo de energía que apenas sostiene el volumen de la semana anterior.

Porque hay una diferencia entre un trabajador que usa IA para pensar mejor, y uno que la usa para no tener que pensar.

Solo uno de los dos seguirá siendo indispensable.

Uriel Hurtado — Bitácora de Cointeligencia