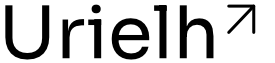

El problema que nadie te contó sobre la IA y los documentos

Seré directo: hay un momento que casi todo el mundo ha vivido.

Le pides a una IA que extraiga un dato de un contrato, una póliza o una factura. Te responde con toda la seguridad del mundo. Citas, números, cláusulas. Todo perfecto. Hasta que revisas el documento original y descubres que eso… simplemente no está ahí.

Eso tiene nombre: alucinación. Y el problema no es que la IA falle. El problema es que falla con confianza.

Los modelos de lenguaje no “leen” como tú y yo. Están entrenados para ser útiles, para completar, para no dejar silencios incómodos. Entonces, cuando no encuentran un dato, su instinto es inventar algo que suene plausible. No por malicia. Por diseño.

La buena noticia: puedes cambiarlo. No necesitas ser programador. Solo necesitas saber cómo pedírselo.

Paso 1: Empieza eligiendo el modelo correcto

Antes de escribir un solo prompt, hay una decisión que importa más de lo que parece: ¿qué modelo estás usando?

No todos los modelos son iguales frente a instrucciones restrictivas. Los modelos rápidos y ligeros están optimizados para responder fluido, para conversar. Eso los hace más propensos a “rellenar huecos” cuando no tienen la respuesta.

Los modelos de razonamiento más avanzados —GPT-4o, Claude Sonnet, Gemini 1.5 Pro— tienen más capacidad para ejecutar instrucciones del tipo “si no lo encuentras, para”. Y esa diferencia, en documentos críticos, lo cambia todo.

Regla simple: Para documentos sensibles, usa siempre el modelo más capaz que tengas disponible. No es el momento de ahorrar tokens.

Paso 2: Activa el “Modo Evidencia”

Aquí está el corazón de todo esto. Esta instrucción —que puedes copiar y pegar directamente— convierte a la IA de un generador de respuestas bonitas en un extractor de datos verificable:

INSTRUCCIÓN DE EXTRACCIÓN — “MODO EVIDENCIA”

Actúa como un auditor de datos estricto. Responde a mis preguntas basándote exclusivamente en el documento adjunto. Sigue estas reglas:

1. Si la información no aparece de forma explícita en el texto, escribe únicamente: “No consta en el documento”. Nada más. Está prohibido adivinar o usar conocimientos externos.

2. Para cada afirmación, incluye: [Cita literal breve] + [Página #] + [Sección o Cláusula].

3. Clasifica cada punto con este semáforo:

- 🟢 VERDE: Cita literal clara y directa.

- 🟡 AMARILLO: Información inferida, sin prueba directa.

- 🔴 ROJO: No consta en el documento.

Presenta la respuesta en una tabla Markdown.

¿Por qué funciona? Porque le da a la IA permiso explícito para decir “no sé”. Y eso, aunque suene pequeño, es enorme. Sin ese permiso, el modelo asume que un silencio es un fracaso. Con él, entiende que la honestidad es la tarea.

“La IA completa tu pregunta con lo que cree que encaja. El problema no es que no responda, es que responde demasiado.”

Paso 3: Verifica en tres niveles (y no saltes ninguno)

Obtener una respuesta con el Modo Evidencia activado es un gran avance. Pero en entornos de alto riesgo, un nivel de verificación no es suficiente.

Nivel 1 — La IA se revisa a sí misma

Dentro del mismo chat, pídele esto:

“Reescanea el documento y, para cada afirmación de tu respuesta anterior, extrae la cita literal exacta. Si no puedes encontrar la cita idéntica, retira esa afirmación.”

La diferencia es sutil pero poderosa: la estás forzando a pasar de generar a buscar. Son dos modos mentales distintos, incluso para una IA.

Nivel 2 — Otro modelo audita al primero

Carga el documento original más el análisis obtenido en un modelo diferente. Si usaste Claude, auditalo con GPT. Si usaste GPT, auditalo con Gemini. Pídele:

“Actúa como auditor externo. Contrasta este análisis con el documento original e identifica cualquier punto sin respaldo claro. Marca las discrepancias.”

Distintas arquitecturas tienen distintos puntos ciegos. Lo que uno pasa por alto, otro lo captura.

Nivel 3 — NotebookLM como árbitro final

Para máxima solidez, usa NotebookLM. Esta herramienta —especializada en gestión de fuentes— genera citas con enlaces directos a la página exacta del PDF. No te dice dónde está el dato: te lleva hasta él.

Un consejo clave: como NotebookLM opera sobre infraestructura Gemini, asegúrate de que tu análisis inicial haya usado un modelo de otra familia (Claude o GPT). Así evitas que los mismos sesgos de interpretación aparezcan en ambas fases.

Para los casos donde el margen de error es cero

Contratos legales. Pólizas médicas. Estados financieros. Situaciones donde un error no es un inconveniente, sino un problema real.

En esos casos, añade esta capa adicional al prompt:

“Solo responde si estás 100% seguro de que la información está en el documento. Si no puedes demostrarlo con una evidencia irrefutable, indica que no consta.”

Sí, obtendrás menos respuestas. Pero las que obtengas serán sólidas. Y en el mundo profesional, un “No consta” honesto vale infinitamente más que una cláusula inventada.

En resumen

Tres pilares. Nada más.

- El modelo correcto — No negocies en esto para documentos críticos.

- El Modo Evidencia — Dale permiso explícito de decirte que no sabe.

- Verificación en capas — Porque la confianza se construye con sistemas, no con fe.

Cuando juntas los tres, la IA deja de ser algo en lo que confías ciegamente y se convierte en algo que puedes auditar. Eso cambia la relación completamente.

¿Qué documento sensible tienes esperando ser procesado ahora que las alucinaciones dejaron de ser un riesgo aceptable?