¡Hola, comunidad! Soy Uriel Hurtado.

Si estás aquí, es porque, como yo, sientes una mezcla de fascinación y vértigo cada vez que lees sobre Inteligencia Artificial. El bombardeo de noticias es constante, pero de vez en cuando, una voz se eleva por encima del ruido y nos deja pensando por días. Esa voz, últimamente, ha sido la de Sam Altman, el CEO de OpenAI.

He estado siguiendo de cerca sus últimas entrevistas y escritos, y he encontrado ideas que son mucho más que simples titulares. Son ideas paradójicas, contradictorias y brutalmente honestas que dibujan un futuro de extremos alucinantes.

Hoy quiero compartir contigo las 5 conclusiones que más me han impactado, porque nos tocan a todos y definen el mundo que ya estamos empezando a vivir.

1. La Paradoja de la Escala: Energía Nuclear para una Sola Consulta

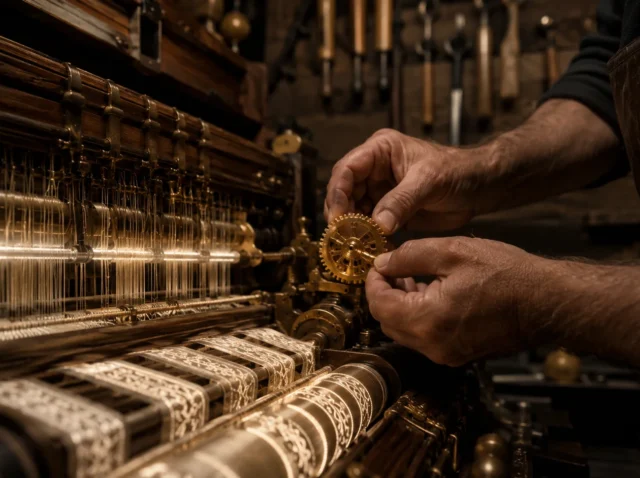

Aquí es donde la mente empieza a volar. Para construir el futuro de la IA, OpenAI y NVIDIA están planeando el “proyecto de infraestructura de IA más grande de la historia”. Hablamos de una inversión que podría llegar a los 100 mil millones de dólares.

Pero el dato realmente increíble es la energía que necesitará: el equivalente a ¡10 reactores nucleares!

Piénsalo por un segundo. La energía de varias ciudades importantes dedicada a la computación. Y ahora, la paradoja: según Altman, una consulta que tú o yo hacemos en ChatGPT consume una cantidad mínima de energía (0.34 vatios-hora).

Entonces, ¿por qué esta escala monumental? Porque no están construyendo un sistema para responder nuestras preguntas, están construyendo una máquina para resolver los problemas más grandes de la humanidad. Este consumo energético no es un dato técnico, es una declaración de intenciones.

2. La Paradoja de la Ambición: De un Chatbot a la Cura del Cáncer

Y aquí es donde esa intención se vuelve tangible. Altman conecta directamente todo ese poder de cómputo con un objetivo que parece de ciencia ficción: curar el cáncer.

Suena audaz, quizás hasta arrogante. Los especialistas nos recuerdan que el cáncer es un conjunto de cientos de enfermedades complejas. Pero antes de descartarlo, recordemos que herramientas como AlphaFold de DeepMind ya están usando IA para acelerar el descubrimiento de fármacos a una velocidad impensable hace años.

La visión de Altman es un ejemplo perfecto de co-inteligencia: no se trata de que una IA en un laboratorio grite “¡Eureka!”, sino de darles a nuestros mejores científicos y médicos una herramienta con un poder de análisis casi infinito. Una herramienta capaz de ver conexiones que el cerebro humano, por brillante que sea, jamás podría procesar.

3. La Paradoja de la Confianza: El Salvador y el Falsificador

Pasamos de la promesa más utópica a la advertencia más urgente. Altman lo ha dicho sin rodeos: estamos al borde de una “crisis de fraude inminente y significativa”.

La misma tecnología que puede clonar proteínas para buscar una cura, puede clonar tu voz o tu rostro en segundos. La capacidad de suplantar nuestra identidad a un nivel perfectamente creíble ya está aquí, y según él, esto “ha derrotado por completo la mayoría de las formas en que la gente se autentica”.

Esta es la dualidad de la herramienta. Nos obliga a ser más críticos y conscientes que nunca. La co-inteligencia también implica una responsabilidad: aprender a usar estas herramientas para crear y proteger, y a defendernos de quienes las usan para engañar y destruir la confianza.

4. La Paradoja del Trabajo: El Fin del Empleo y el Inicio del Juego

¿Qué pasará con nuestros trabajos? Esta es, quizás, la pregunta que más nos inquieta. La visión de Altman aquí es de las más extrañas y, a la vez, optimistas que he escuchado.

Él no niega lo evidente: “clases enteras de trabajos desaparecerán”. Sin embargo, no parece demasiado preocupado. Su predicción es que, en un futuro de abundancia radical creada por la IA, el concepto de “trabajo” como lo conocemos podría volverse obsoleto.

Describe un futuro donde, al tener todas nuestras necesidades cubiertas, nos “inventaremos trabajos para jugar un ‘juego de estatus tonto’ y para sentirnos útiles”. Puede sonar frívolo, pero el trasfondo es profundo: un futuro donde nuestro valor no resida en nuestra productividad laboral, sino en nuestra creatividad, nuestras pasiones y nuestras conexiones humanas.

5. La Paradoja de la Inteligencia: Para Ser Humana, Debe Ser Sobrehumana

Finalmente, ¿cuándo sabremos que una IA ha alcanzado la inteligencia humana (AGI)? Olvídate del test de Turing clásico. Altman ha propuesto un nuevo estándar, acordado con el padre de la computación cuántica, David Deutsch.

La nueva prueba es esta: se considerará que una IA ha alcanzado la inteligencia de nivel humano cuando pueda resolver y explicar la gravedad cuántica.

¿Por qué un listón tan increíblemente alto? Porque la verdadera inteligencia no consiste en replicar el conocimiento que ya existe (algo que los modelos actuales hacen de maravilla), sino en crear conocimiento fundamentalmente nuevo. Es la diferencia entre un estudiante brillante que memoriza todos los libros y el genio que escribe un capítulo que nadie había imaginado.

Nuestra Decisión en un Futuro de Extremos

La visión de Sam Altman es un espejo de nuestro tiempo: llena de contradicciones poderosas. Una tecnología que es, al mismo tiempo, la cura y el arma. Una fuerza que puede liberarnos del trabajo pero que exige una responsabilidad sin precedentes.

Mientras ellos construyen este futuro, la pregunta ya no es si estamos listos para él. La verdadera pregunta es: ¿cómo vamos a participar activamente en su diseño?

Me encantaría saber qué piensas. ¿Cuál de estas paradojas te resuena más? ¿Te ilusiona o te preocupa este futuro? Déjame tu opinión en los comentarios.

¡Hablamos pronto!

Uriel.

Comentario

IA?